当ChatGPT引发中美科技行业狂热之后,它的缔造者美国OpenAI公司如今又在人工智能(AI)可解释性研究领域获得重大突破。

钛媒体App 5月10日消息,OpenAI今晨发布一个关于GPT-4语言模型解析神经元的对齐性研究成果,利用自研基于GPT-4技术的开源工具,来尝试计算其他架构、更简单语言模型上神经元的行为并对其进行评分,而且可以将其应用于另一种语言模型中的神经元——本次选择4年前发布、包含307200个神经元的大模型GPT-2为实验样本,公开了这些GPT-2神经元解释和分数的数据集。

“我们的目标是使用 Al 来帮助我们理解 Al”,OpenAI 的这一研究对 AI 行业意味着,利用GPT-4和机器学习技术就能定义、测量 AI 可解释性,未来在神经元层将会产生“大模型比人脑更会思考”技术趋势。

OpenAI 联合创始人 Greg Brockman则表示:我们迈出了使用 AI 进行自动化对齐研究的重要一步。

与此同时,OpenAI 对此依然是一如既往的谦虚,文章称目前GPT-4生成的可解释实验还不完美,当比GPT-2更大模型时解释表现效果很差。OpenAI可拓展对齐团队的Jeff Wu直言,本次研究中大多数解释的得分很低,GPT-4或无法解释实际神经元那么多的行为,未来仍有技术改进空间。

据悉,自去年11月底至今,人工智能(AI)聊天机器人大模型ChatGPT风靡全球。根据Similarweb公布的最新数据,截至今年4月,ChatGPT平台访问量达到17.6亿次,比3月份增长了12.6%,同时已达到谷歌的2%。

ChatGPT背后的大型语言模型(LLM),是基于大量文本数据训练、包含数千亿(或更多)参数的语言模型。在大数据时代,这类 AI 机器学习模型可以在提升产品销售、辅助人类决策过程中能够起到很大的作用,但是计算机通常不会解释它们的预测结果,而语言模型想要变得更强大,部署更广泛,就需要研究可解释性(interpretability),因为人类对模型内部工作原理的理解仍然非常有限,例如可能很难从中检测到有偏见、欺骗性内容输出。

站在OpenAI 的角度看,大模型未来将和人脑一样拥有“神经元”(neurons),这些神经元会观察文本中的特定规律,进而影响到模型本身生产的文本。所以可解释性就是将模型能用通俗易懂的语言进行表达,把模型的预测过程转化成具备逻辑关系的规则的能力,从而通过查看模型内部来发现更多信息。

例如,如果有一个针对“漫威超级英雄”的神经元,当用户向模型提问“哪个超级英雄的能力最强”时,这个神经元就会提高模型在回答中说出漫威英雄的概率,或者是弄清楚为什么人类神经元,可以决定进行某些搜索引擎查询或访问特定网站,即逐步转化一种有数据可解释性的“无监督学习”模式。

OpenAI这次使用GPT-4来解决可解释性的问题,就是希望能够使用自动化的方式,让机器提高 AI 数据准确性,文章称这是其对齐研究的第三支柱的一部分。据悉,“第三支柱”是公司2022年发布的《我们做对齐研究的方法》,具体对齐研究将由三大支柱支撑:利用人工反馈训练 AI;训练 AI 系统协助人类评估;训练 AI 系统进行对齐研究。

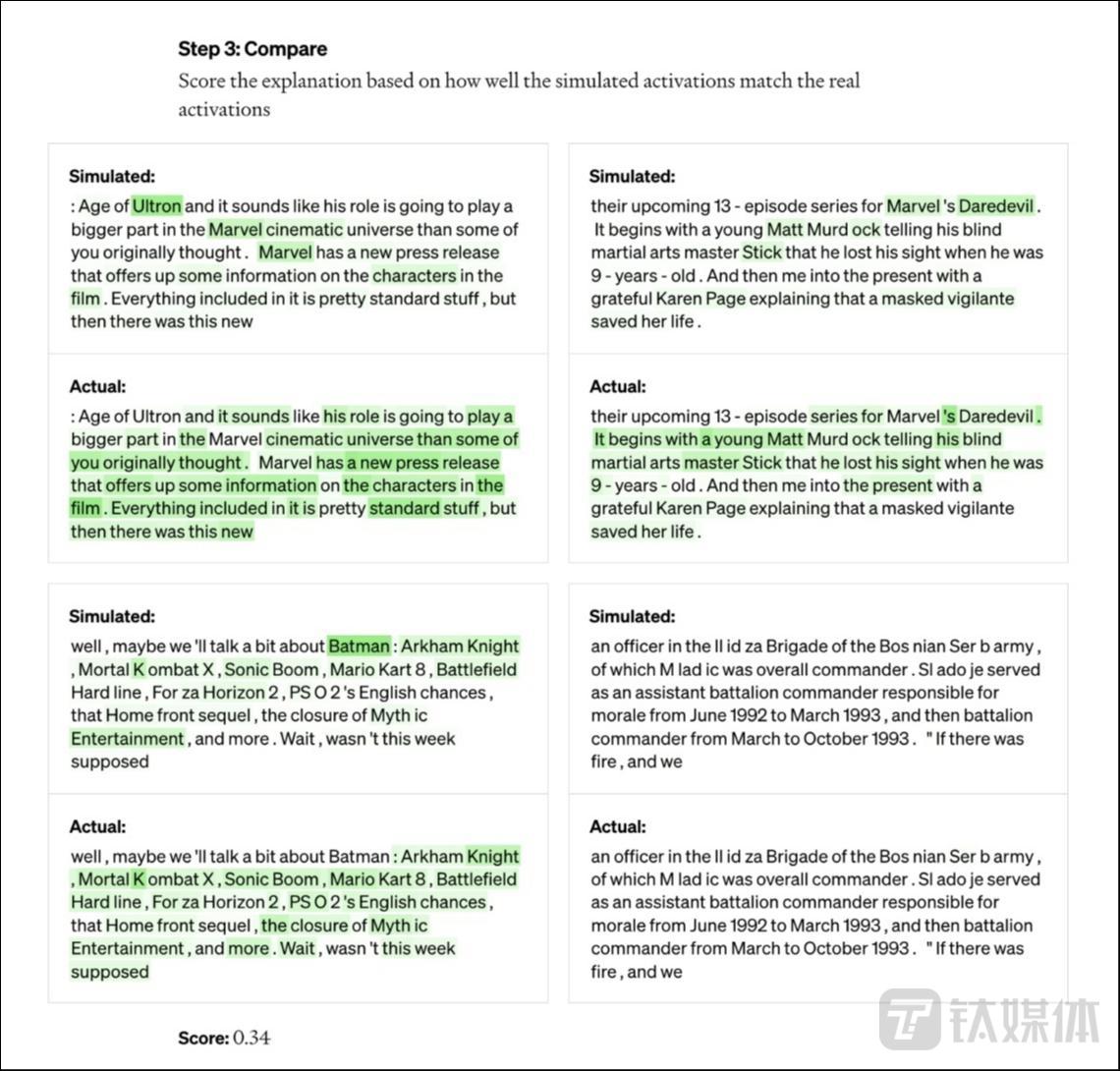

具体到本次研究成果上,OpenAI 开发了一套包含自动化工具和测试方法的评估流程:

首先,研究人员让GPT-2运行文本序列,等待某个特定神经元被频繁“激活”;

然后让 GPT-4 针对一段文本生成解释,例如通过GPT-4接收到文本和激活情况判断漫威是否与电影、角色和娱乐有关;

随后用 GPT-4 模拟 GPT-2 的神经元接下来会做什么,预测行为;

最后评估打分,对比GPT-4模拟神经元和GPT-2真实神经元的结果的准确度,在下图这个例子中,GPT-4 的得分为0.34。

使用上述评分方法,OpenAI 开始衡量他们的技术对网络不同部分的效果,并尝试针对目前解释不清楚的部分改进技术。OpenAI 表示,他们正在将GPT-4编写的对GPT-2中的所有307,200个神经元的解释的数据集和可视化工具开源,同时还提供了OpenAI API公开可用的模型进行解释和评分的代码,从而希望学术界能开发出新的技术来提升GPT模型解释分数。

OpenAI还发现,有超过 1000 个神经元的解释得分至少为0.8分,这意味着GPT-4模型可以解释大部分人类神经元,同时目前GPT理解的概念似乎和人类不太一样。该团队称,希望随着技术和研究方法的改进,进一步提高AI模型可解释性能力:如通过迭代解释,可以让GPT-4想出可能的反例在根据激活情况修改解释;使用更大的模型作出解释;以及调整已解释模型(explained model)结构等,用不同的激活函数训练模型有助于提高解释评分。

对于本研究局限性,OpenAI表示,目前GPT-4生成的解释还不完美,尤其要解释比GPT-2更大的模型时,表现效果很差;神经元复杂行为无法用简短的自然语言描述;OpenAI 解释了神经元的这种行为,却没有试图解释产生这种行为的机制;而且整个过程算力消耗极大等。OpenAI 希望在未来的工作中可以解决上述这些问题。

最终,OpenAI希望使用模型来形成、测试和迭代完全一般的假设,从而比肩人类大脑的想法和行为,以及将其大模型解释为一种在部署前后检测对齐和安全问题的方法。然而在这之前,OpenAI还有很长的路要走。

“我们希望这将开辟一条有前途的途径。”Jeff Wu表示,这一技术可以让其他人可以在此基础上构建并做出贡献的自动化方案,从而解决 AI 模型可解释性问题,很好地解释这些模型行为,比如 AI 如何影响人类大脑中的神经元等。